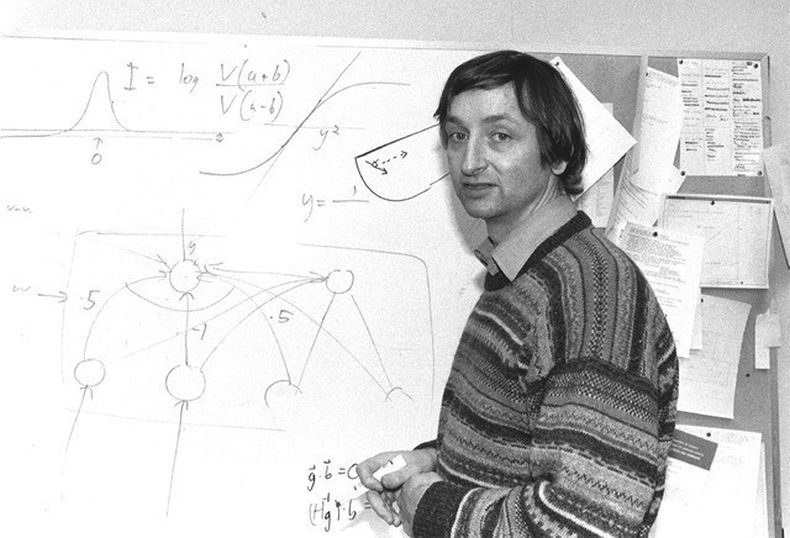

Aunque los chatbots como ChatGPT penetraron en el espíritu de nuestros tiempos hace muy poco, ciertos círculos de Silicon Valley han profetizado sobre el poder de la IA durante décadas.

“Tratamos de despertar a la gente”, dijo Hinton. “Para que el público entienda los riesgos y presione a los políticos para que hagan algo al respecto”.

Mientras que investigadores como Hinton advierten sobre la amenaza existencial que, en su opinión, representa la IA para la humanidad, hay CEO y teóricos en el otro lado del espectro que argumentan que nos acercamos a una especie de apocalipsis tecnológico que inaugurará una nueva era en la evolución humana.

En un ensayo publicado el año pasado titulado “Machines of Loving Grace: How AI Could Transform the World for the Better” (“Máquinas de gracia amorosa: Cómo la IA podría transformar el mundo para mejor”, el CEO de Anthropic, Dario Amodei, expone su visión de un futuro “si todo sale bien con la IA”.

El empresario de IA predice “la derrota de la mayoría de las enfermedades, el crecimiento de la libertad biológica y cognitiva, la salida de miles de millones de personas de la pobreza para compartir las nuevas tecnologías, un renacimiento de la democracia liberal y los derechos humanos”.

Mientras que Amodei opta por la frase “IA poderosa”, otros usan términos como “la singularidad” o “inteligencia artificial general (IAG)”. Aunque los defensores de estos conceptos no suelen estar de acuerdo en cómo definirlos, se refieren, en términos generales, a un futuro hipotético en el que la IA superará la inteligencia humana, con el potencial de desencadenar cambios rápidos e irreversibles en la sociedad.

El científico informático y autor Ray Kurzweil ha pronosticado desde la década de 1990 que los humanos algún día se fusionarán con la tecnología, un concepto a menudo llamado transhumanismo.

“No podremos distinguir lo que proviene de nuestro propio cerebro de lo que proviene de la IA. Todo estará incrustado dentro de nosotros. Y nos hará más inteligentes”, dijo Kurzweil.

En su más reciente libro, “The Singularity Is Nearer: When We Merge with AI” (“La singularidad está más cerca: Cuando nos fusionamos con la IA”), Kurzweil reafirma sus predicciones anteriores. Cree que para 2045 habremos “multiplicado nuestra propia inteligencia un millón de veces”.

“Sí”, admitió finalmente cuando se le preguntó si considera a la IA como su religión. Ello habla de su sentido de propósito.

“Mis pensamientos sobre el futuro y el futuro de la tecnología y la rapidez con la que está llegando definitivamente influyen en mis actitudes hacia el hecho de estar aquí y lo que estoy haciendo, y cómo puedo influir en otras personas”, dijo.

A pesar de la invocación explícita de Thiel del lenguaje utilizado en el Libro del Apocalipsis, las visiones positivas de un futuro con IA son más “apocalípticas” en el sentido histórico de la palabra.

“En el mundo antiguo, apocalíptico no tiene una connotación negativa”, explica Domenico Agostini, profesor de la Universidad de Nápoles L’Orientale, que estudia la literatura apocalíptica antigua. “Hemos cambiado completamente la semántica de esta palabra”.

El término “apocalipsis” proviene de la palabra griega “apokalypsis”, que significa “revelación”. Aunque a menudo se asocia hoy en día con el fin del mundo, en el pensamiento judío y cristiano antiguo, los apocalipsis eran una fuente de aliento en tiempos de dificultad o persecución.

“Dios promete un nuevo mundo”, dijo el profesor Robert Geraci, que estudia religión y tecnología en el Knox College. “Para ocupar ese nuevo mundo, debes tener un cuerpo nuevo y glorioso que triunfe sobre el mal que todos experimentamos”.

A principios de la década de 2000, Geraci notó por primera vez que se usaba un lenguaje apocalíptico para describir el potencial de la IA. Kurzweil y otros teóricos lo inspiraron a escribir su libro de 2010, “Apocalyptic AI: Visions of Heaven in Robotics, Artificial Intelligence, and Virtual Reality” (“IA apocalíptica: Visiones del cielo en robótica, inteligencia artificial y realidad virtual”).

El lenguaje le recordaba al cristianismo primitivo. “Solo que vamos a sacar a Dios e introducir... tu elección de leyes cósmicas de la ciencia que supuestamente hacen esto y luego tendríamos el mismo tipo de futuro glorioso por venir”, dijo.

Geraci argumenta que este tipo de lenguaje no ha cambiado mucho desde que comenzó a estudiarlo. Lo que le sorprende es que esté tan generalizado.

“Lo que una vez fue muy extraño, hoy está en todas partes”, dijo.

Un factor en el creciente culto a la IA es la rentabilidad.

“Hace veinte años, esa fantasía, verdadera o no, realmente no generaba mucho dinero”, dijo Geraci. Ahora, sin embargo, “existe un incentivo financiero para que Sam Altman diga que la IAG está a la vuelta de la esquina”.

Pero Geraci, que argumenta que ChatGPT “no es ni remotamente, vagamente, plausiblemente consciente”, cree que puede haber algo más que impulsa este fenómeno.

Históricamente, el mundo tecnológico ha estado notoriamente desprovisto de religión. Su reputación secular lo precedía tanto que un episodio de la serie de comedia satírica de HBO, “Silicon Valley”, gira en torno a “sacar del armario” a un compañero de trabajo como cristiano.

En lugar de considerar la veneración del mundo tecnológico escéptico hacia la IA como algo irónico, Geraci cree que mantienen un vínculo causal.

“Los seres humanos somos profundamente, profundamente, inherentemente religiosos”, dijo, y agregó que las impresionantes tecnologías detrás de la IA podrían atraer a personas en Silicon Valley que ya han dejado de lado “enfoques ordinarios hacia la trascendencia y el significado”.

No todos los CEO de Silicon Valley se han convertido, aun cuando quieren participar en la tecnología.

“Cuando las personas en la industria tecnológica hablan de construir esta única y verdadera IA, es casi como si pensaran que están creando a Dios o algo así”, dijo el CEO de Meta, Mark Zuckerberg, en un podcast el año pasado, mientras promocionaba la incursión de su empresa en la IA.

Aunque las teorías transhumanistas como las de Kurzweil se han vuelto más generalizadas, todavía no son omnipresentes en Silicon Valley.

“El argumento científico para eso no es de ninguna manera más fuerte que el argumento para una vida después de la muerte de tipo religioso”, argumenta Max Tegmark, físico e investigador de aprendizaje automático del Instituto de Tecnología de Massachusetts.

Al igual que Hinton, Tegmark se ha manifestado abiertamente sobre los posibles riesgos de la IA no regulada. En 2023, como presidente del Instituto para el Futuro de la Vida, Tegmark ayudó a liderar una carta abierta en la que pedía a los poderosos laboratorios de IA que “pausen inmediatamente” el entrenamiento de sus sistemas.

La carta recogió más de 33,000 firmas, entre ellas, las de Elon Musk y del cofundador de Apple, Steve Wozniak. Tegmark considera que la carta fue exitosa porque ayudó a “normalizar la conversación” sobre la seguridad de la IA, pero cree que su trabajo está lejos de terminar.

Con regulaciones y salvaguardas, Tegmark piensa que la IA puede usarse como una herramienta para hacer cosas como curar enfermedades y aumentar la productividad humana. Pero es imperativo, argumenta, mantenerse alejado de la carrera “bastante marginal” en la que se encuentran algunas empresas: “la búsqueda pseudorreligiosa de tratar de construir un Dios alternativo”.

“Hay muchas historias en textos religiosos y, por ejemplo, en la mitología griega antigua, sobre cómo cuando los humanos comenzamos a jugar a ser dioses, las cosas terminan mal”, dijo. “Y siento que hay mucha arrogancia en San Francisco en este momento”.

___

La cobertura de temas religiosos de The Associated Press recibe apoyo a través de la colaboración de la AP con The Conversation US, con financiamiento de Lilly Endowment Inc. La AP es la única responsable de este contenido.

___

Esta historia fue traducida del inglés por un editor de AP con la ayuda de una herramienta de inteligencia artificial generativa.

FUENTE: Associated Press